AI 走入戰場:國防部官員披露自動化目標建議機制

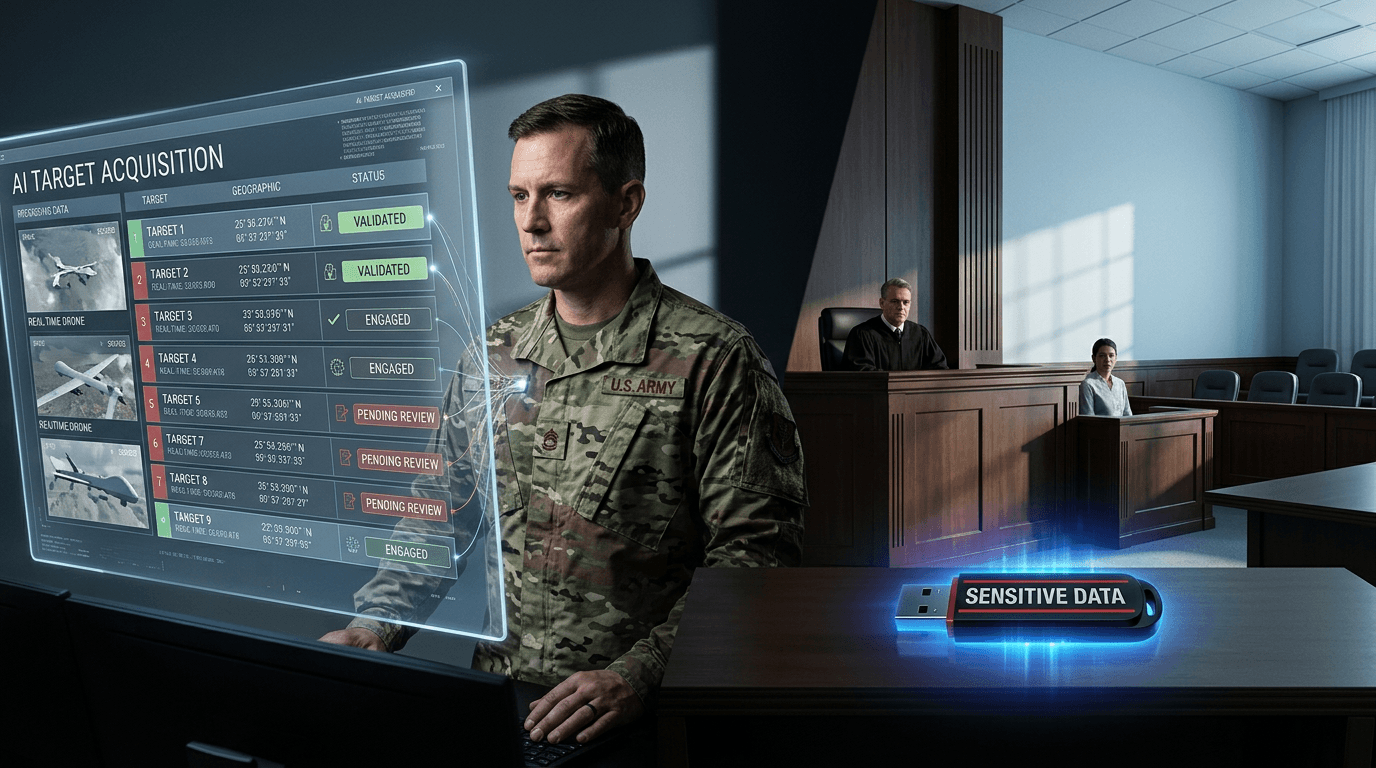

根據 MIT 科技評論的一份披露,美國國防部官員證實,軍方正在考慮利用生成式 AI 聊天機器人來協助複雜的打擊決策。這項技術並非直接取代人類操作員,而是透過 AI 系統對潛在目標進行排序並提供打擊建議,最後再由人類官員進行審核與核准。這一披露正值五角大廈因多起精準打擊事件面臨各界審查之際。官員指出,AI 的優勢在於能快速處理海量情資,但在生死攸關的戰爭環境下,如何確保「人類判斷」的有效性,已成為道德與法律的核心爭議。

Anthropic 與國防部的法律角力:安全性與合規性的碰撞

與軍事應用同步推進的,是 AI 巨頭 Anthropic 與美國政府之間錯綜複雜的法律糾紛。根據 Wired 的報導,這場被稱為「恐怖谷」(Uncanny Valley)的法律戰,主要圍繞著 Anthropic 的安全框架是否能與國防採購程序相容。Anthropic 一直強調其「憲法 AI」(Constitutional AI)的安全性,但在面對國防部的高機密需求與潛在的武器化應用時,雙方的合作模式引發了行政程序法(APA)層面的法律質疑。這起訴訟不僅關係到百億美元的採購合同,更將定義生成式 AI 在軍事防衛領域的紅線。

資料外洩疑雲:DOGE 操作員約翰·索利遭檢舉

在政策與軍事的交界處,一場涉及個人誠信與國家安全的醜聞正在發酵。Wired 報導指出,一名前政府部門合作人員約翰·索利(John Solly)被指控在轉職至國防承包商 Leidos 之前,非法下載並攜帶了包含敏感社會安全資料的隨身碟。索利曾與名為「DOGE」的政府效率組織有過密切合作,舉報者稱其計畫將這些資料用於新職位的商業研發。雖然索利與 Leidos 均對此堅決否認,但此事件已觸發聯邦貿易秘密法(DTSA)與社會安全局隱私條例的全面調查,突顯了 AI 時代政府資料管理的脆弱性。

專家觀點:法律架構能否追上軍事科技?

法律專家分析,目前的法律架構如國防部 3000.09 指令,雖然要求在 AI 系統中使用「適當的人類判斷」,但在實際操作中,這種「建議機制」是否會導致人類的「自動化偏見」(Automation Bias)仍是未知數。此外,國際人道法(IHL)要求所有攻擊必須遵循區分原則與比例原則,若 AI 在目標排序中出現偏誤,責任歸屬將極其複雜。Anthropic 的案件更是成為一個標竿,測試著民用 AI 公司在面對國家安全契約時,如何保持其標榜的「安全性」與「不作惡」原則。

未來趨勢:透明度與監管的角力

隨著 2026 年軍事科技的快速演進,AI 的透明度將成為各國監管的重中之重。五角大廈雖然試圖推動 AI 現代化,但法律訴訟與資料洩漏醜聞無疑減緩了這一進程。公眾與國會議員對於 AI 介入戰爭決策的憂慮正在升溫,預計未來幾個月內,針對軍用 AI 的聽證會將更加頻繁。這不僅是一場科技競賽,更是一場關於道德防線的法律保衛戰。