國家安全與 AI 倫理的正面碰撞

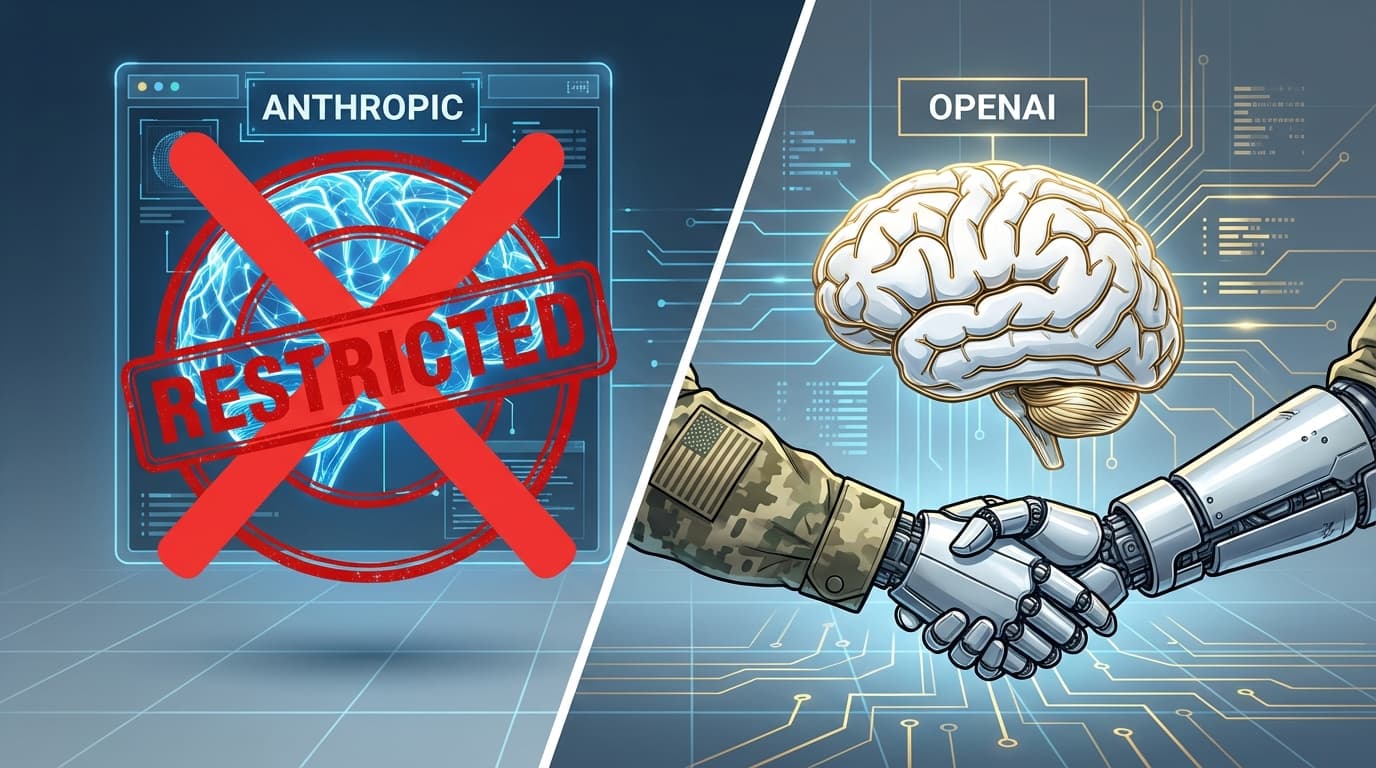

矽谷與華府的關係在 2026 年 2 月底走到了臨界點。川普政府正式下令所有聯邦機構停止使用由 Anthropic 開發的 AI 技術,並將其列入「供應鏈風險」名單。根據 The Verge (2026) 的報導,此舉源於 Anthropic 拒絕放寬其對軍事用途的倫理限制。國防部長 Pete Hegseth 表示,Anthropic 的立場已構成國家安全隱患,聯邦政府必須確保其使用的 AI 模型不會在關鍵時刻受到「軟體倫理」的束縛。

Anthropic 對此強烈回擊,稱這項禁令在法律上是站不住腳的。根據 Wired (2026) 的分析,該公司認為五角大廈將其列為風險的理由缺乏事實根據。然而,這場僵局已在科技界引發了巨大的寒蟬效應,許多原本致力於「AI 安全」的實驗室現在面臨著生存考驗。

OpenAI 的戰略轉向:安全還是妥協?

就在 Anthropic 被封殺的同時,其主要對手 OpenAI 迅速採取行動填補了權力真空。OpenAI 執行長 Sam Altman 宣佈,公司已與國防部達成一項包含「技術保障措施」的新型軍事合約。根據 TechCrunch (2026) 的報導,儘管 Altman 承認這項交易在光學表現上(Optics)「看起來並不好」,但他強調 OpenAI 已建立了一套精密的過濾系統,確保 AI 在輔助軍事決策時仍能遵守國際人道法。

這項交易被視為 OpenAI 政治立場的重大轉向。過去,該公司曾因其對軍事用途的嚴格限制而受到讚譽,但如今為了確保在龐大的聯邦採購市場中的地位,顯然選擇了更務實的道路。分析人士指出,這項合約的價值可能高達數十億美元,將為 OpenAI 未來的 AGI 研究提供充足的資金來源。

法律與監管:行政權力的過度擴張?

此次針對 Anthropic 的封殺令,主要依據的是《國際緊急經濟權力法》(IEEPA)及《國防授權法》(NDAA)第 889 條。這些法律賦予總統極大的權限,可以因國家安全考量而黑名單化特定供應商。Anthropic 具備根據《行政程序法》(APA)提出法律挑戰的空間,主張政府的決定缺乏正當程序或事實基礎,這與過去 TikTok 或小米挑戰類似禁令的案例異曲同工。

矽谷的未來:一個分裂的 AI 生態系

這場爭端不僅是兩家公司之間的競爭,更預示著 AI 發展路徑的分裂。一方面是堅持「有效利他主義」與倫理護欄的 Anthropic,正逐漸被排擠出核心權力圈;另一方面則是與國家機器深度繫結的 OpenAI,雖然獲得了資金與資源,卻面臨著失去開源社群與倫理支持者的風險。隨著川普政府持續加強對尖端技術的控制,矽谷的 AI 實驗室或許不得不做出選擇:成為「愛國者」還是「旁觀者」。