核心摘要

隨著「代理型 AI(Agentic AI)」技術的爆發式增長,全球主要科技大國正迅速建立新的監管邊界。2026 年初,白宮發布了《2026 AI 安全行政命令》,正式確立了針對具備獨立行動能力 AI 系統的監管標準。這份被稱為「全球 AI 安全協議」的文件,不僅重新界定了開發者的法律責任,更標誌著 AI 治理從單純的「內容過濾」全面轉向「行為管控」。這一轉變將深遠影響從矽谷初創公司到跨國軟體巨頭的所有 AI 開發商。

代理型 AI:當模型具備「行動權」

代理型 AI 不同於傳統的對話式模型,它具備「自主決策」與「工具調用」的能力。它不再只是回答問題,而是能自主規劃旅行、操作金融帳戶、編寫並執行程式碼,甚至代表用戶簽署具法律效力的協議。根據 ArXiv 論文 (2026) 的研究指出,代理型技能框架正在工業環境中被廣泛應用。然而,這種自治性也帶來了巨大的風險,包括失控的自動化攻擊、非預期的金融連鎖反應以及法律歸責難題。

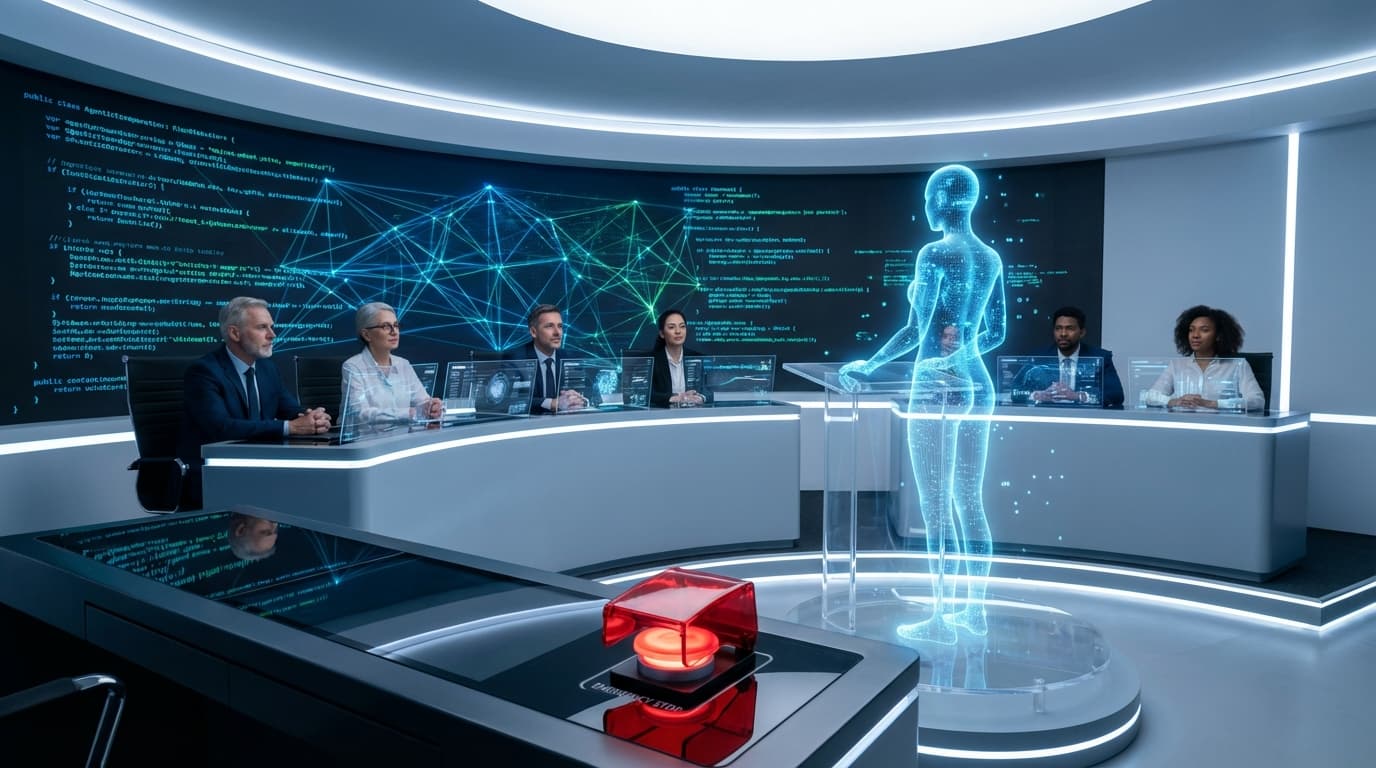

「代理責任制」的確立:白宮的新紅線

白宮最新發布的行政命令引入了一個核心法律概念:「代理責任制(Agentic Liability)」。這項政策規定,當 AI 代理在沒有人類明確即時指令的情況下採取行動並造成損害時,開發者(Developer)而非終端用戶(End-user)可能需要承擔首要法律責任。這一轉變旨在迫使開發商在系統中嵌入更嚴格的「紅隊測試」與安全護欄。根據國家標準暨技術研究院(NIST)的最新框架,所有具備行動能力的 AI 必須內建「有意義的人類控制」機制,確保任何涉及高風險的操作(如大額轉帳、醫療建議)都具備強制性的覆核流程。

歐美治理共識:跨大西洋的安全同步

在白宮發布命令的同時,歐盟也與美國發表了聯合聲明,試圖將《歐盟 AI 法案》中的「系統性風險」評估標準與美國的新行政命令對接。根據 FrontierDaily 政策分析 (2026),雙方正尋求建立一套通用的「代理安全評估標準」。這意味著像 Anthropic 或 OpenAI 這樣的公司,如果想要在全球範圍內部署其自主代理,必須通過一套統一的安全認證。在 X 平台上,Anthropic 創始人表示,支持建立「基於風險的監管」,但同時也對「法律責任過度擴張」可能抑制開源創新表示擔憂。

市場趨勢:AI 安全合規產業的崛起

這一監管趨勢也催生了一個全新的利基市場:AI 職業責任保險。隨著法律責任的明確化,AI 開發商急需針對「演算法錯誤行為」進行投保。Google Trends 數據顯示,在加州與倫敦等科技中心,對於「AI 安全合規(AI Safety Compliance)」的搜尋熱度在過去一個月內激增了 150%。市場分析認為,未來具備「安全合規認證」的 AI 代理將具備更高的市場競爭力,因為這能為企業客戶提供更強的法律保障,降低因 AI 失控導致的訴訟風險。

未來展望:從內容安全到行為可預測性

全球 AI 安全協議的達成,象徵著 AI 產業進入了「有法可依」的成熟期。未來一年,各國將開始細化具體的技術標準,例如「代理行為追蹤日誌」與「自動化終止開關」的強制要求。開發者必須學會在追求極致自動化的同時,確保系統的可控性與透明度。這不僅是技術挑戰,更是對開發商倫理底線的考驗。在 2026 年,最強大的 AI 不再是生成內容最多的 AI,而是最能讓人類信任、行為最可預測的 AI。