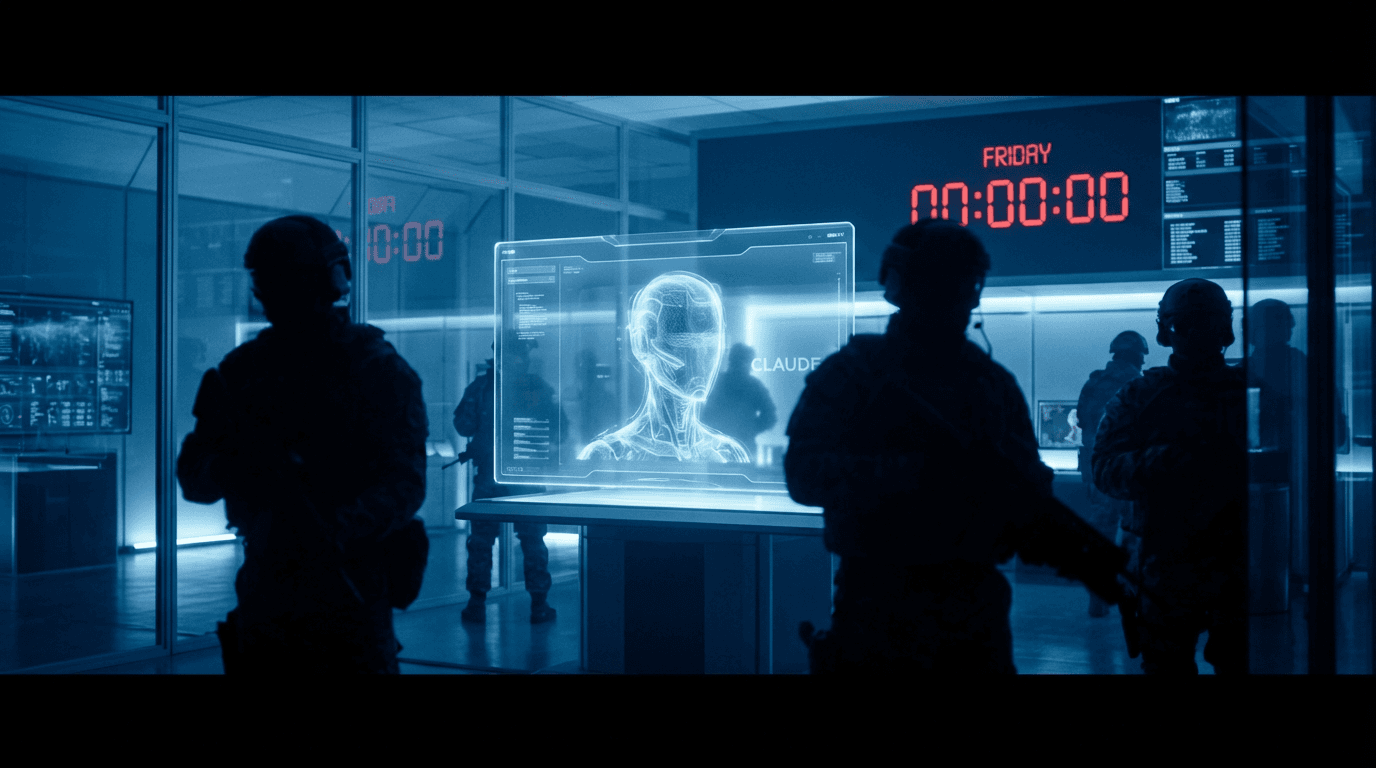

國防主權 vs AI 安全:Anthropic 面臨五角大廈「週五最後通牒」

最後通牒:五角大廈與 Anthropic 的安全紅線之爭

在人工智能發展與國家安全利益的交匯點上,一場高規格的法律與技術博弈正推向頂點。根據 BBC Tech (2026) 與 TechCrunch (2026) 的報導,美國五角大廈已向人工智能新星 Anthropic 下達了最後通牒,要求該公司在週五前放寬其 AI 模型 Claude 的安全限制(Guardrails),否則將面臨潛在的法律制裁與合約懲罰。

這起衝突的核心在於 Anthropic 對其產品 Claude 設定了嚴格的「紅線」,禁止模型參與直接的軍事攻擊規劃或武器系統決策。然而,美國國防部認為這些限制阻礙了 AI 在現代電子戰、威脅分析及後勤優化中的應用效率。此事件標誌著民營 AI 公司與政府國防需求之間的張力已從學術辯論轉向了現實權力的對抗。

Claude Cowork:在監管風暴中進軍企業市場

儘管深陷與國防部的監管僵局,Anthropic 並未放慢商用化的腳步。該公司剛剛推出了名為 Claude Cowork 的企業級 Agent 平台,旨在全面接管企業的繁瑣工作流程。根據 VentureBeat (2026) 的報導,Anthropic 美洲負責人 Kate Jensen 指出,2025 年的企業 AI 熱潮大多是「早產」的,許多試驗項目未能真正投入生產。

Claude Cowork 代表了 Anthropic 的新策略:從單純的聊天機器人轉型為具備執行力的「協作代理」。該系統能讀取並分析遺留代碼(如 COBOL),將其轉換為 Java 或 Python,直接對標 IBM 的核心業務領域。然而,諷刺的是,Anthropic 正是在強調其「安全性」與「可控性」的同時,被軍方要求降低其防禦性。

法律博弈:國防生產法與第 14110 號行政命令

法律專家指出,五角大廈此次的威脅背後有著強大的法源依據。根據 The Verge (2026) 的分析,美國政府可能援引《國防生產法》(DPA)以及第 14110 號關於 AI 安全的行政命令。該命令要求開發最強大 AI 系統的公司必須向政府通報安全測試結果。

Anthropic 的處境極其尷尬:作為一家以「AI 安全性」為核心價值觀的公司,若屈服於軍方壓力,將損害其與學術界及隱私倡導者的信任;若拒絕執行,則可能失去數十億美元的政府合約,甚至面臨國家安全名義下的行政介入。這種「雙重標準」——要求商用版極度安全,卻要求國防版降低防禦——正成為 AI 時代的新政治常態。

市場趨勢與社會反應

根據 Google Trends 的最新數據,AI 相關主題在加州的搜尋熱度達到 75,而在台灣則高達 88。這顯示出亞太地區與美國科技中心對 AI 監管動向的高度敏感。在台灣,針對「LLM Ranking」與「Agentic Workflow」的熱度持續上升,反映出開發者對 AI 工具實用性的渴求。

此事件在社交媒體上也引發了激烈的討論。部分隱私倡議者擔心,放寬紅線後的 Claude 可能被用於跨境監視或更具破壞性的網絡行動。而技術現實主義者則認為,若西方公司不為軍方提供強大的 AI 支撐,將在與其他地緣政治對手的競爭中處於劣勢。

未來展望:雙用途 AI 的監管瓶頸

Anthropic 的遭遇只是開端。未來,如何定義「雙用途(Dual-use)」AI 的邊界將是政策制定者的最大挑戰。隨著 AI Agent 具備更高的自主性,簡單的文字紅線已不足以阻止模型被誤用。

對於企業用戶而言,這場爭議也提出了一個關鍵問題:當 AI 供應商與政府發生衝突時,企業數據的安全性是否會成為博弈的籌碼?Anthropic 必須證明,在 Claude Cowork 協助企業轉型的同時,其核心的安全底線依然能抵抗來自最強權國家的壓力。